В 2015 году команда DeepMind, возглавляемая Демисом Хассабисом и Мустафой Сулейманом, начала масштабный эксперимент по созданию системы управления безопасностью искусственного интеллекта, стремясь предотвратить доминирование корпорации Google над развитием мощного ИИ.

Первый шаг — попытка создать независимый совет по безопасности ИИ, проведённая в августе 2015 на базе SpaceX при участии Илона Маска и руководства Google — оказалась неудачной. Личные конфликты и разногласия по стратегии управления привели к отсутствию конкретных решений. Более того, Илон Маск, использовав полученную информацию, основал конкурирующую организацию OpenAI как противовес DeepMind.

Вызов заставил Сулеймана искать альтернативные механизмы управления. В итоге DeepMind получила возможность стать полунезависимой структурой внутри новой холдинговой компании Alphabet — модель 3-3-3, где три места в совете занимали представители DeepMind, три — Alphabet, и три — независимые эксперты. Такая схема должна была обеспечить баланс между коммерческими интересами и ответственным контролем за разработкой AGI.

Важным элементом стратегии стала диверсификация источников дохода: Сулейман запустил подразделение DeepMind Health, ориентированное на экономию в здравоохранении, а Хассабис организовал закрытую команду для разработки алгоритмов высокочастотной торговли — проект, вдохновлённый хедж-фондом Renaissance Technologies. Однако последний был закрыт из-за осторожной позиции Google.

Переговоры с руководством Alphabet продолжались до конца 2016 года. Несмотря на формальное одобрение целей безопасности, окончательное решение о полной независимости DeepMind так и не было принято — проявилась сложность балансирования между инновациями, корпоративными интересами и этическими вопросами.

Этот опыт повлиял на Демиса Хассабиса, сделав его менее идеалистичным и более прагматичным в вопросах управления и безопасности ИИ. Он показал, что даже в привилегированных условиях создание эффективной системы контроля за мощными технологиями требует сложных компромиссов.

П

Поделиться:

Ещё публикации

Все посты →Как дизайнеру пересобрать процессы и вернуть смысл в работу →

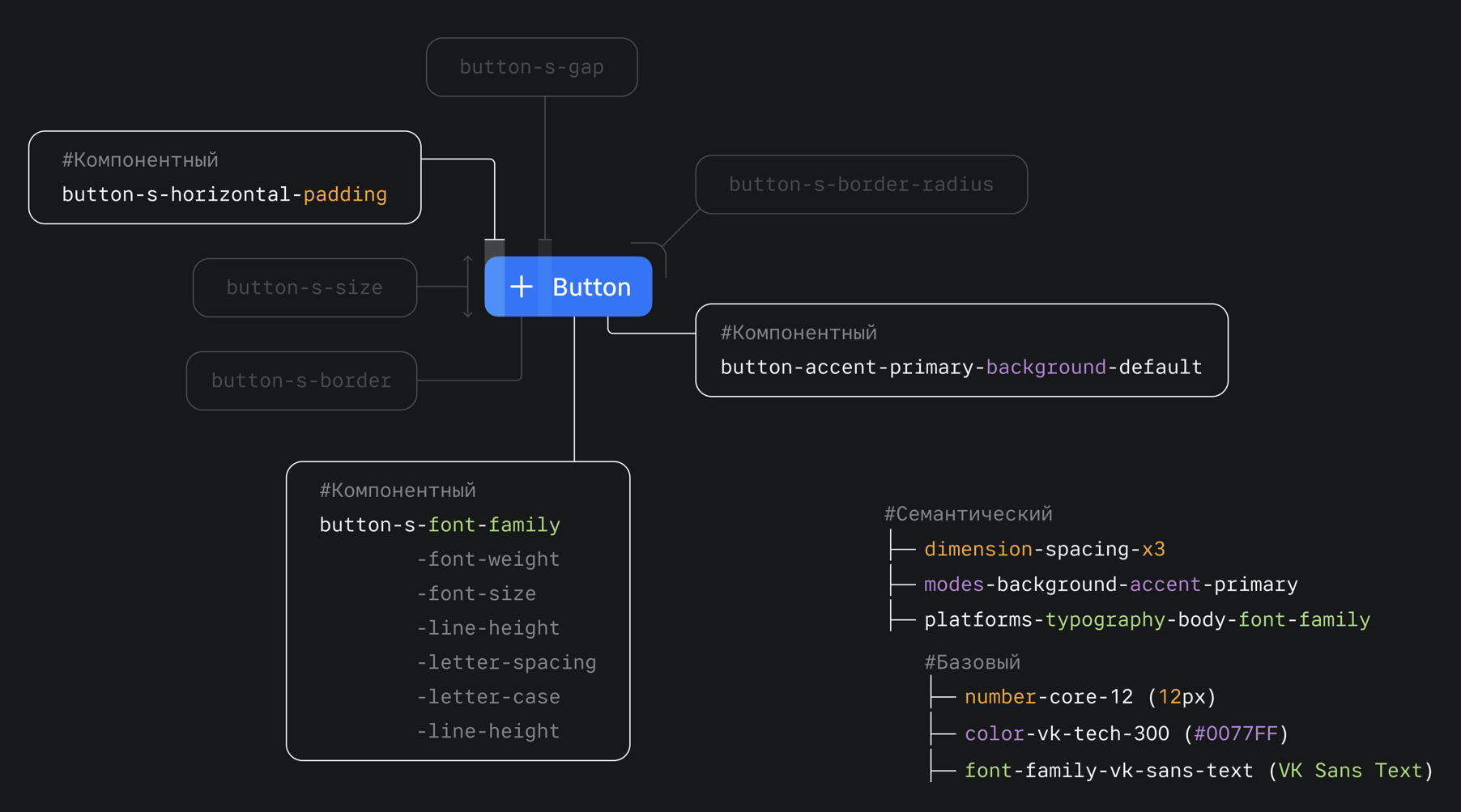

Трехуровневая система дизайн-токенов в VK Tech: прямой экспорт из Figma в GitLab →