Сейчас AI умеет не просто помогать с задачами — он может искать уязвимости и писать эксплойты. Именно поэтому OpenAI готовит новую модель с продвинутыми киберспособностями, но собирается раздавать её очень избирательно, только проверенным компаниям. Это похоже на стратегию Anthropic с их моделью Mythos, которая тоже доступна лишь ограниченному кругу специалистов.

Всё началось после запуска GPT-5.3-Codex и программы Trusted Access for Cyber, где OpenAI уже выделил 10 миллионов долларов API-кредитов для исследователей, чтобы те могли использовать их модели для защиты, а не взлома. Понимают, что технологии могут стать двусторонним мечом — в плохих руках они угрожают критической инфраструктуре: водоканалам, электросетям и финансам.

Эксперты уже давно бьют тревогу, и теперь это не просто страхи — возможности AI для взлома реально существуют. Как сказал Роб Ли из SANS Institute: "Невозможно запретить моделям изучать код и искать в нём уязвимости." А другие лидеры индустрии считают, что вскоре такие модели появятся и вне ограниченного доступа.

Интересно, что подход с постепенным и ограниченным выпуском новых моделей напоминает практику ответственного раскрытия уязвимостей в софте — сначала показывают проблему узкому кругу, чтобы не навредить сразу всем.

Пока остаётся вопрос: выпустит ли OpenAI эту модель для широкой публики когда-нибудь? Anthropic точно говорит, что Mythos Preview в открытый доступ не попадёт, но возможно другие версии — да, при хороших ограничениях.

Если хотите подробнее, почитайте про программу OpenAI Trusted Access for Cyber и про ограниченный релиз Mythos.

Кто уже следит за таким развитием AI? Какие мысли на счёт этики и безопасности? Делитесь в комментариях!

Поделиться:

Ещё публикации

Все посты →Как дизайнеру пересобрать процессы и вернуть смысл в работу →

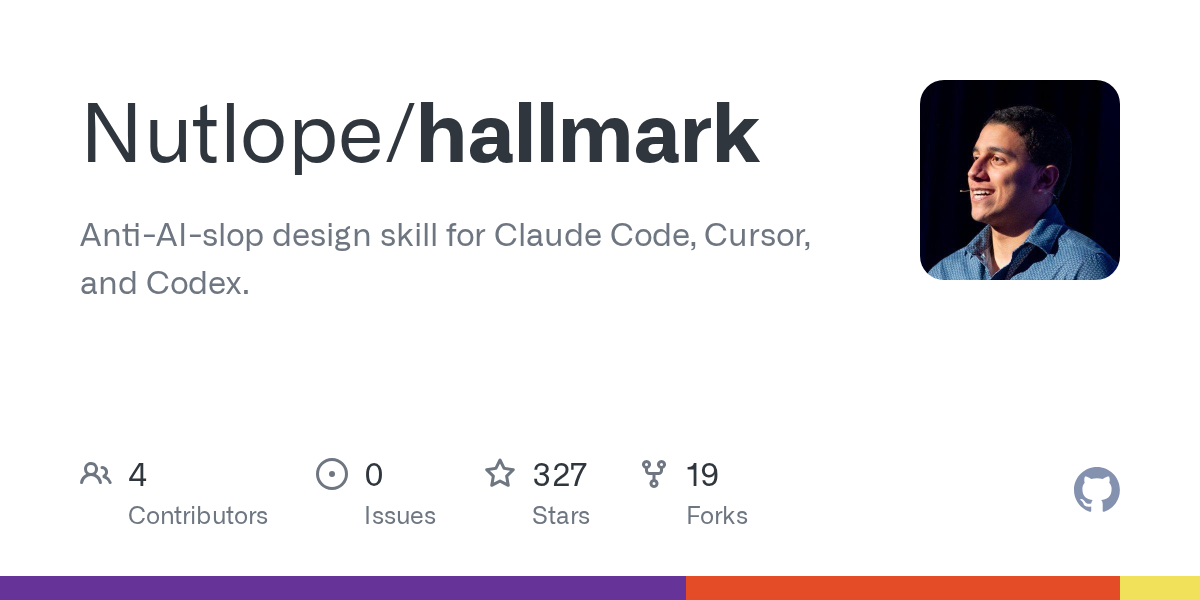

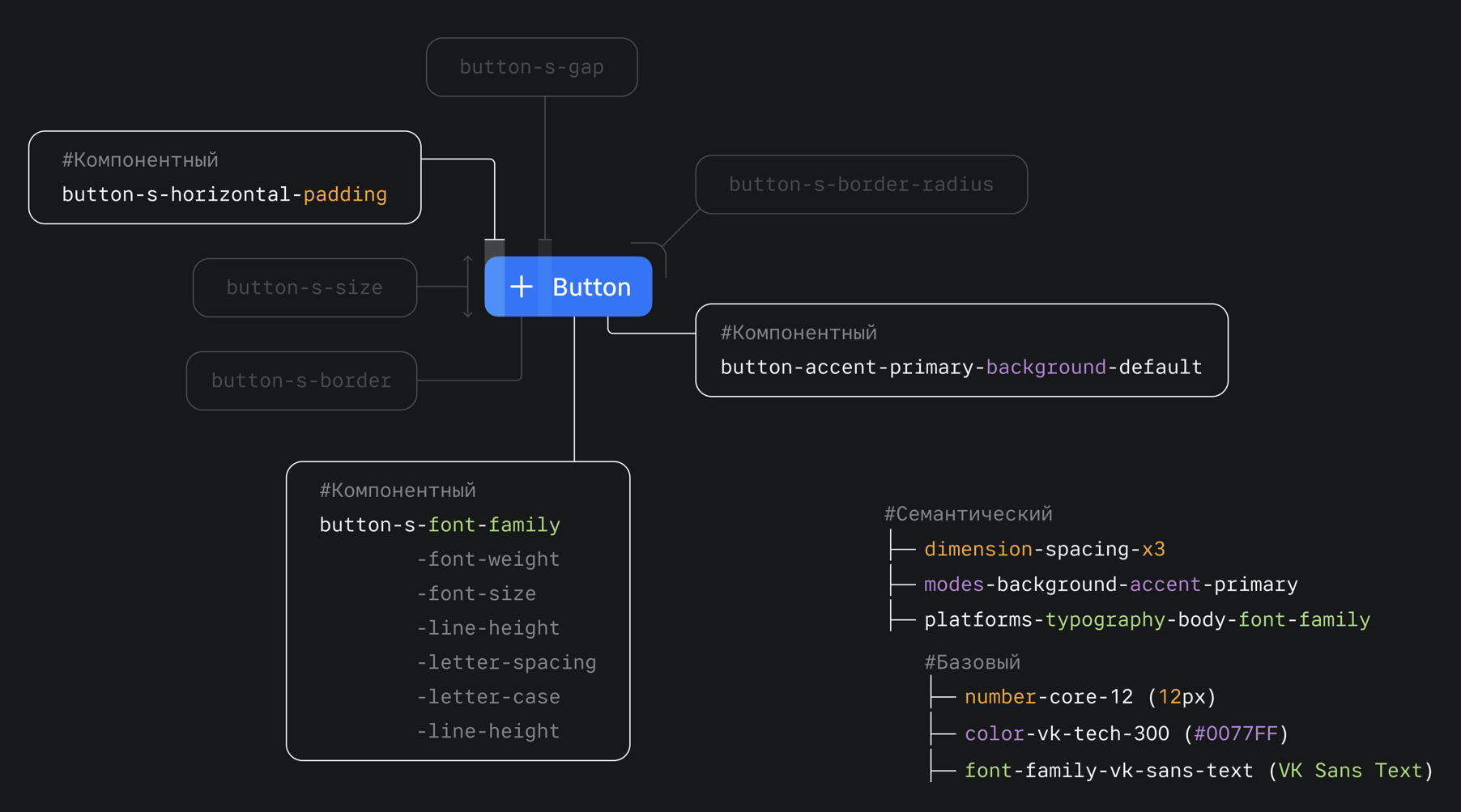

Hallmark: опенсорсный скилл для Cursor и Claude Code, отучающий нейросети делать шаблонный дизайн →