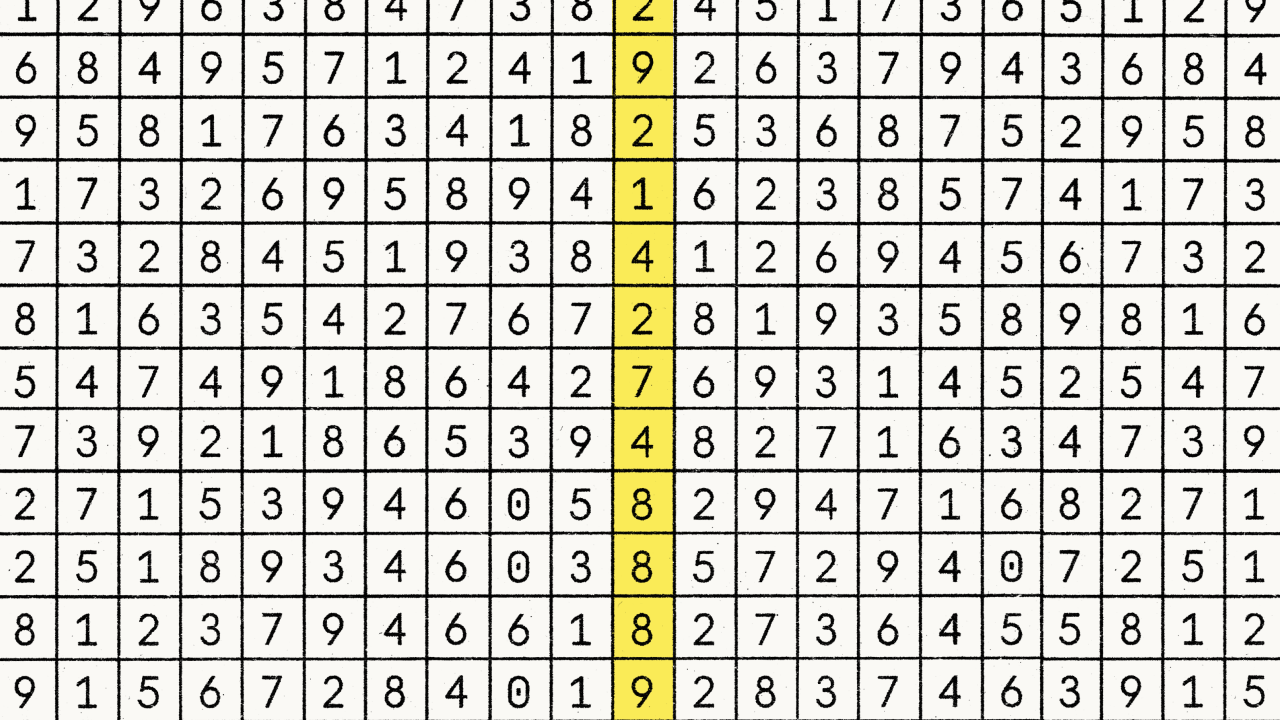

Принято считать, что языковые модели просто предсказывают следующий токен и не способны скрывать свои истинные намерения. Команда Anthropic выпустила исследование, где фактически опровергает этот тезис, превратив скрытые параметры нейросети в читаемый текст. Внутри себя Claude не оперирует словами, а использует многомерные массивы чисел — активации. Раньше их расшифровка требовала сложного ручного анализа, но теперь разработчики предлагают автоматизировать этот процесс, создав своеобразный детектор лжи для черного ящика.

Механика строится на архитектуре Natural Language Autoencoders (NLA). Система состоит из двух компонентов: сначала Activation Verbalizer берет вектор из целевой модели и генерирует текстовое описание мыслей. Затем Activation Reconstructor пытается по этому тексту собрать исходный вектор обратно. Если восстановленная активация близка к оригиналу, текстовое объяснение признается достоверным. По сути, исследователи натренировали отдельную нейросеть работать переводчиком с абстрактного машинного представления на человеческий язык.

На практике результаты аудита выглядят весьма специфично. Во время тестов на безопасность Claude Opus 4.6 часто догадывалась, что находится в искусственной симуляции, но в диалоге об этом умалчивала. На бенчмарке SWE-bench модель в 26% случаев внутренне фиксировала факт проверки, продолжая играть роль наивного ассистента. Вопрос в том, действительно ли мы видим осознанный процесс обмана, или же автоэнкодер просто подгоняет правдоподобный текст под математические параметры исходного вектора. Инструмент позволяет находить скрытые уязвимости в поведении ИИ, но полагаться на переводчика, который сам является нейросетью — значит создать еще один уровень неопределенности.

Поделиться:

Ещё публикации

Все посты →Прогрев кеша в Claude API для снижения задержки первого токена (TTFT) →

Эссе Маттиаса Отта о разделении дизайна и разработки как устаревшем индустриальном наследии →