OpenAI представила Codex-Spark на процессорах от Cerebras. Эта модель выдает до 1000 токенов в секунду. Она предназначена для быстрого выполнения простых задач с 128k токенами контекста.

Основные улучшения включают:

- Снижение накладных расходов на 80%

- Уменьшение задержки на токен на 30%

- Сокращение времени до первого токена на 50%

- Постоянное WebSocket-соединение вместо обычных запросов

Codex-Spark использует Wafer Scale Engine 3 для высокоскоростного инференса. Это помогает добиться низкой задержки в ответах на запросы. Хотя она доступна только в ChatGPT Pro за 200 долларов, OpenAI планирует расширить доступ и добавить модель в API для партнеров.

Скорость ответа становится критически важной. Модели уже достаточно умные, но важнее, как быстро они отвечают. Codex-Spark — это шаг к улучшению взаимодействия с ИИ при программировании. Больше информации можно узнать в видео.

Поделиться:

Ещё публикации

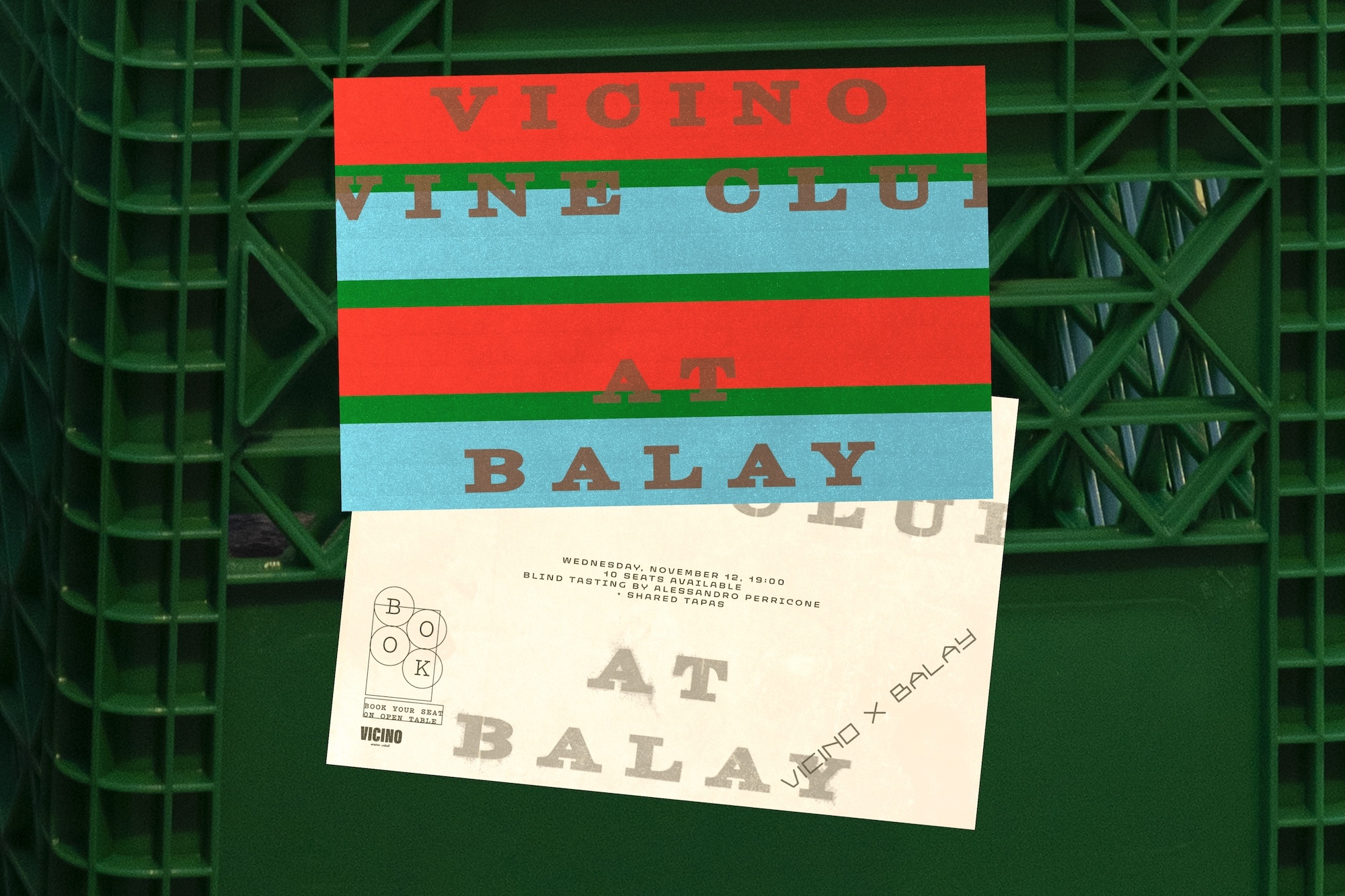

Все посты →Дизайн миланского бара Balay: отказ от эстетики listening bar в пользу филиппинского хаоса и винтажной типографики →

Институционализация ИИ-генерации в коммерческом видеопродакшене на примере Zero Studio →