Мало кто задумывается об архитектурном изъяне современных инструментов для работы с персональными базами знаний. Загружая гигабайты файлов в чат-боты, пользователи полагаются на классический RAG. При каждом сложном запросе модель заново ищет релевантные куски текста и пытается собрать их воедино. Система ничего не накапливает глобально — она вынуждена каждый раз изобретать велосипед, заново синтезируя информацию из разрозненных фрагментов.

Настоящую альтернативу этому подходу описал исследователь Анджей Карпати, чью концепцию LLM Wiki сейчас начали активно применять на связке Claude Code и Obsidian. Идея заключается в отказе от поиска по сырым данным во время пользовательского запроса. Вместо этого локальный AI-агент постоянно поддерживает и инкрементально обновляет структурированную базу в формате markdown. Когда появляется новый источник, нейросеть не просто кидает его в индекс. Она читает текст, извлекает факты и органично вплетает их в существующий граф: обновляет страницы конкретных сущностей, переписывает сводки и фиксирует противоречия с прошлыми записями.

В результате между сырыми данными и пользователем формируется самообновляющийся слой скомпилированных знаний. Кросс-ссылки уже проставлены, а конфликтующие факты подсвечены до того, как вы зададите вопрос. Если натравить десктопного агента от Anthropic на локальную директорию с заметками, получается автономный процесс, который фоново поддерживает идеальный порядок в знаниях, избавляя LLM от необходимости восстанавливать ваш рабочий контекст с нуля при каждом диалоге.

Поделиться:

Ещё публикации

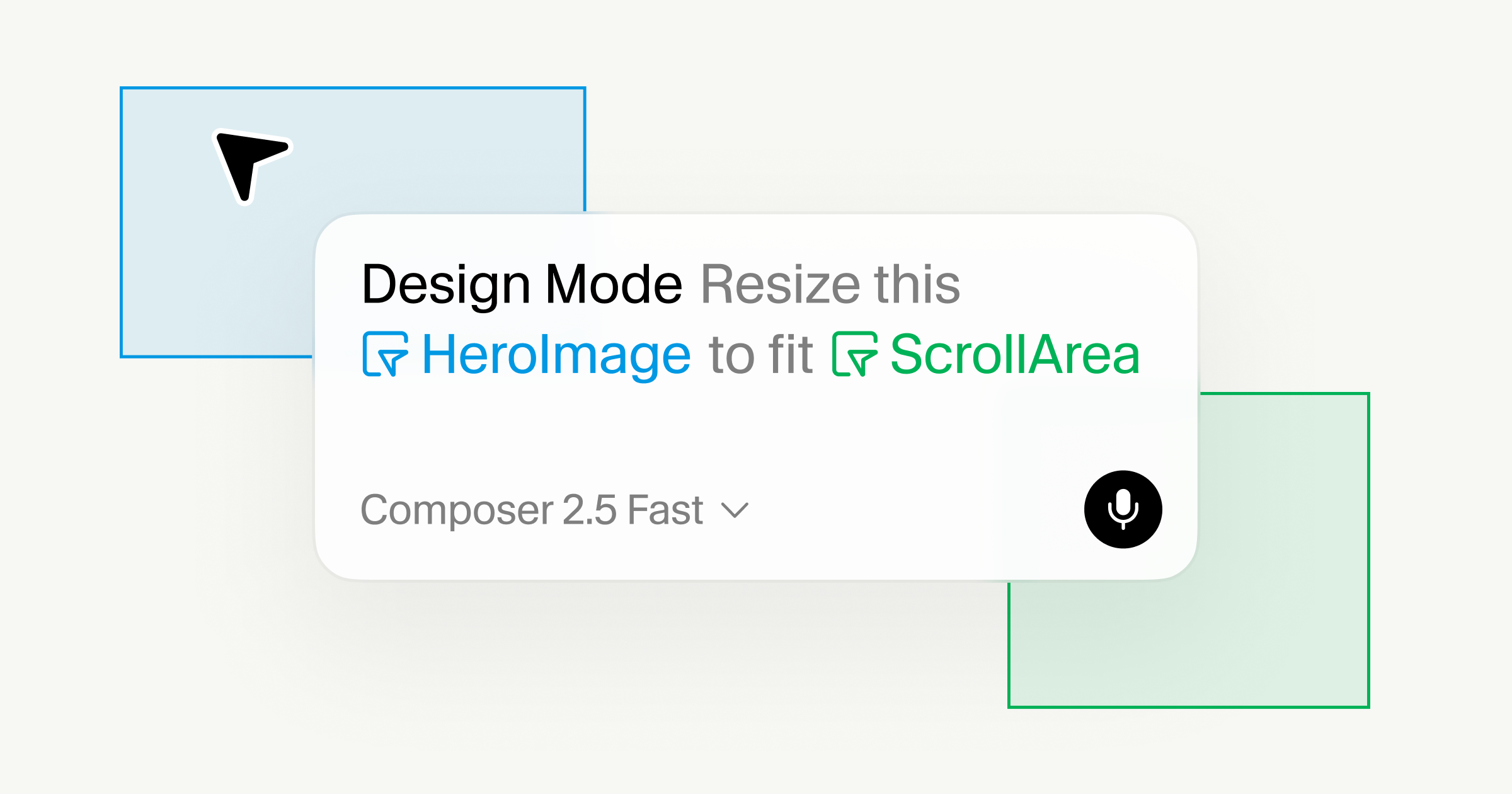

Все посты →Визуальные промпты в Cursor Design Mode: почему кликать по экрану — не значит писать код →

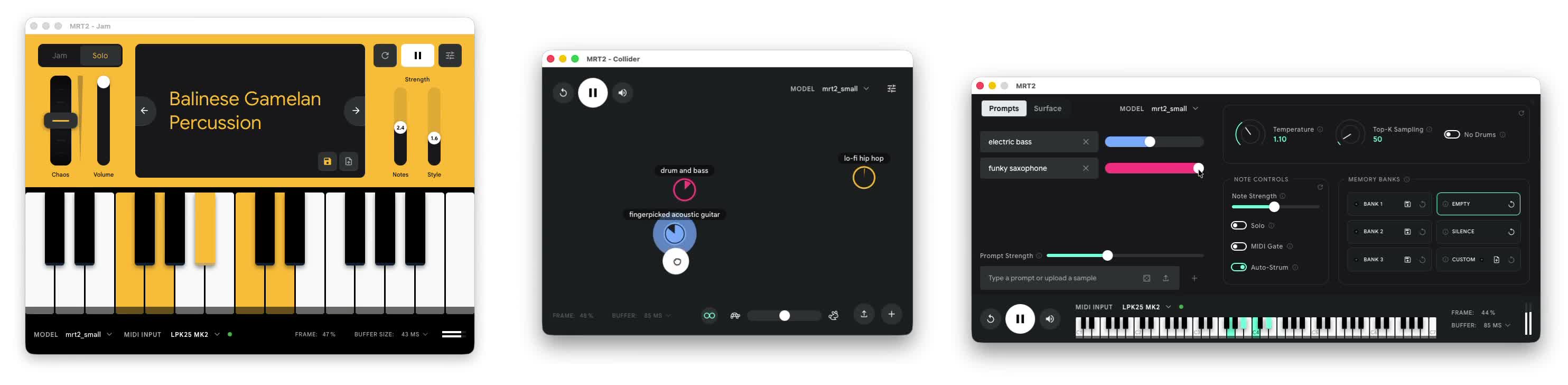

Плагин MagicPath для Codex: бесконечный канвас, импорт UI из репозиториев и генерация React-компонентов →