Генерация видео уходит от формата одного промпта. Разработчики Happy Oyster представили новую мультимодальную world-модель. Она генерирует сцены в реальном времени. Система реагирует на команды прямо в процессе рендера. Модель одновременно создает видео и звук. Физика, освещение и логика объектов остаются стабильными на протяжении всего ролика.

Инструмент предлагает два режима. Первый — Directing. Это интерактивная режиссура с длиной видео до 3 минут в 720p. Нейросеть выдает непрерывный поток кадров. Пользователь вмешивается текстом или голосом в любой момент. Можно сменить ракурс, направить персонажа или изменить сюжет. Окружение перестраивается на лету без остановки генерации.

Второй режим — Wandering. Это создание пространства с управлением через стандартную раскладку WASD. Сессия длится до 1 минуты в разрешении 480p. По тексту или исходному изображению собирается стабильная 3D-сцена. Пользователь перемещается по ней от первого лица. Объекты сохраняют свои координаты на карте. Перспектива и освещение пересчитываются динамически при движении виртуальной камеры. Инструмент заточен под быстрое прототипирование игр и концепт-артов.

Поделиться:

Ещё публикации

Все посты →Автономные агенты в генеративном видео: что стоит за релизом PAI 2.0 от Utopai →

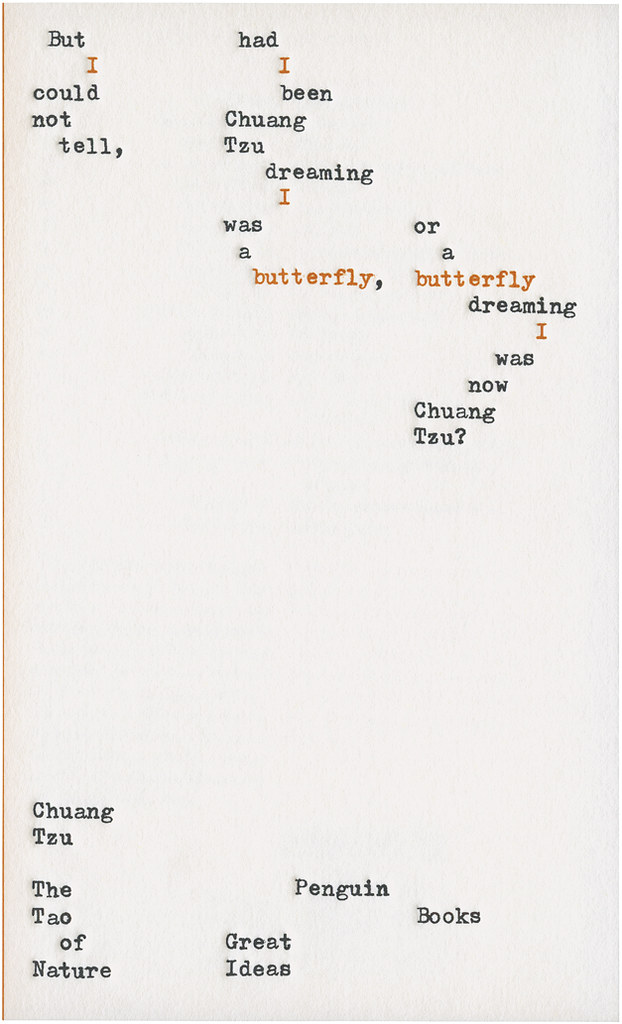

Типографический дизайн серии Penguin Great Ideas от Дэвида Пирсона →