Мало кто обратил внимание, но с выходом Kimi K2.6 open-source модели перешли от генерации сниппетов к многочасовому автономному рефакторингу. Пока большинство тестирует чат-ботов на простых скриптах, эта архитектура способна удерживать контекст на протяжении тысяч вызовов инструментов. Во время внутренних тестов агент взял восьмилетний финансовый движок exchange-core, проанализировал графы распределения памяти (flame graphs) и самостоятельно изменил топологию потоков. За тринадцать часов непрерывной работы модель увеличила пропускную способность почти втрое, выжав максимум из кодовой базы, которая считалась предельно оптимизированной.

Если копнуть глубже в логи исполнения, становится ясно, что K2.6 отлично справляется с out-of-distribution задачами. Нейросети поручили развернуть локальную модель на Mac и написать логику инференса на Zig — весьма специфичном языке программирования. Спустя 14 итераций и более четырех тысяч вызовов утилит, агент поднял скорость обработки токенов с 15 до 193 в секунду. Подобная стабильность в long-horizon сценариях делает эту сеть серьезным инструментом для создания автономных роев агентов, способных сутками ковырять legacy-код без галлюцинаций.

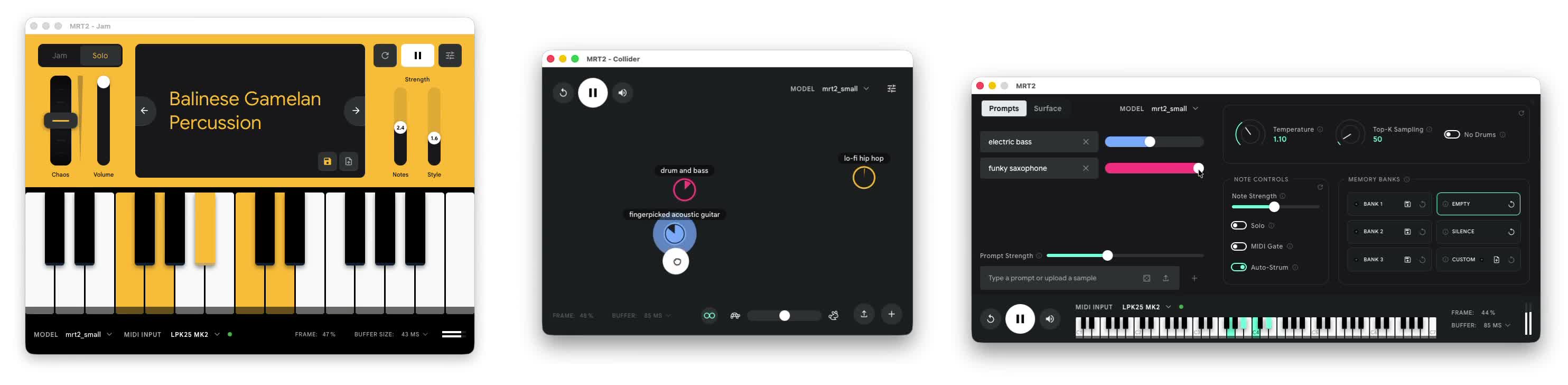

Помимо сурового бэкенда, разработчики заложили в систему концепцию coding-driven design. K2.6 не просто верстает статику по текстовому описанию, а собирает полноценные интерактивные интерфейсы со сложными анимациями и триггерами скролла. При этом пайплайн не ограничивается фронтендом: модель способна выстраивать легковесные full-stack процессы, связывая аутентификацию, пользовательский ввод и запись транзакций в базу данных. Грань между визуальным прототипом и готовым к деплою микросервисом становится всё тоньше.

Поделиться:

Ещё публикации

Все посты →Бесплатный учебник по Agentic AI: от основ Python до архитектуры автономных агентов →

Гибридный подход к AI-ревью: как Alibaba пытается усмирить LLM-агентов в open-code-review →